AMS DMXのベーシックな設定は「セブン・イレブン」

- Goh さんはとても状態の良い AMS DMX の実機をお持ちだそうですね。

そうですね、結構いい状態です。ちょっとだけエラーもあるんですけど、問題なく使えます。15年くらい前に日本で買ったんですよ。昔は日本のどのスタジオにも、DMX と AMS RMX(リバーブ)の両方がありましたね。

- 従来のデジタルディレイとは何が違ったのでしょうか?

やっぱりピッチを正確に調整できることでしょうね。それ以前のピッチシフトはモジュレーションでなんとなくやっていたから、どれくらい上がっているのか、下がっているのかがわからなかったんです。DMX が登場したことで、正確かつ綿密にピッチシフトができるようになりました。

- Goh さんはいつ頃から DMX を使い始めたんですか?

僕がエンジニアの仕事を始めたのが1980年くらいで、使い始めたのは85年くらいですね。その頃から DMX と RMX は大体どのスタジオに行ってもありました。ただ、当時でもかなり高価だったので、2台あるスタジオはあまりなかったですね。

- DMX と RMX の音はちょっと不自然さもありますけど、80年代を象徴するサウンドですよね。

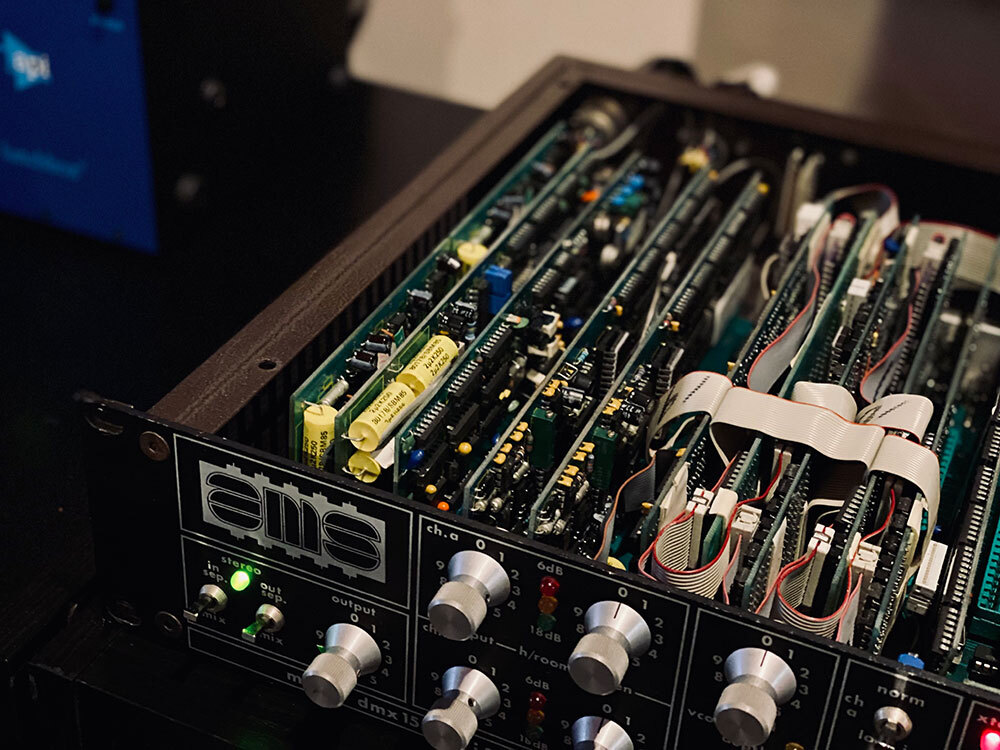

天板を開けるとわかるんですけど、メモリのロジックがすごいんですよ。LとRがちゃんとディスクリートなんです。で、実機では「lock in」という機能があって、サンプリングができたんです。だから、例えばスネアとかのオーディオ信号を入れると、トリガーして音が出せたんですよ。

- いわゆるドラム・リプレイサーですね。

そうそう。Audio to MIDIみたいな。

- デジタルディレイであり、ピッチシフターであり、サンプラーでもあるんですね。

AKAI のサンプラーが出てくるあたりまでは、DMX のサンプラーも結構使いました。例えば同じスネアにしても、ch.a(L)のピッチをちょっと上げて、ch.b(R)のピッチをちょっと下げて鳴らしたり。

- LとRでピッチをズラすんですね。

使い方は今も昔もほとんど同じです。僕は「セブン・イレブン」って呼んでいるんですけど、ch.aのディレイを[7ms]、ch.bを[11ms]に設定します。そして、ピッチはch.aを[1.002cent]と少し上げて、ch.bは[0.997cent]と少し下げる。これがベーシックな設定です。ディレイタイムは、ch.aを[9ms]、ch.bを[14ms]とかにすることもあるし、エンジニアによってはピッチを奇数(1.003cent)と偶数(0.998cent)に分けるという人もいました。ピッチを[0.991cent]とか極端に下げると振れ幅が細かくなるので、振れ幅をなんとなく曲のテンポに合わせます。テンポが早い曲はディレイタイムを結構長くしても大丈夫なんですよ。

- そうやってステレオ感を調整するわけですか。

そういうことです。ベーシックなステレオエフェクトの選択肢として、僕は DMX と Roland Dimension D を用意しておきました。コーラスのように極端にかけたい時は Dimension D、左右にもっと広がりが欲しい時は DMX に入れます。コーラス的に広げるのか、ピッチ的に広げるのかの違いですね。パッドやハーモニーのような、ちょっと広げたいパートはどんどん DMX に入れていく。ボーカルも入れるし、コーラスも入れる。そうしていくと DMX の中の情報がすごい量になるから、その入れ方にすごくセンスが問われるわけです。あんまり入れ過ぎるとグワングワンになっちゃう。

- それがエイティーズならではの不思議感につながっているわけですね。

例えば、ボーカルをダブルにする時、うまい人が重ねるとフランジするような感じになっちゃうでしょ? だから1本だけ録るんですよ。で、その生音を左側に振り、右側には DMX でピッチを上げるか下げるかした音を振る。ディレイがちょっとかかっていて、フィードバックはない。そうやってダブルにすると、結構エイティーズの音になりますよ。

ボーカルの音像がものすごく広く、大きくなる

- DMX をよく使っていたパートは?

大体ボーカルでしょうね。リードボーカルは間違いなく DMX に入れます。音像がものすごく広く、大きくなるから、今でもそういう処理をしていますよ。UADプラグインの DMX が出る前は、soundtoys の MicroShift とかが一番近い効果が得られたんですけど、アメリカのエンジニアなんかは DMX の音が好きだって言いますね。グランジ感というか、音にザラザラした質感があるんですよ。DMX がないスタジオでは、代わりに Eventide H3000 っていうハーモナイザーが使われたんですけど、同じ設定にしても DMX と同じ音にはなりません。今はボーカルをちょっと膨らませるボーカルダブラーみたいなプラグインがあるけど、それも基本的に原理は同じなので DMX で全部できるんです。当時は今みたいにパラレル処理ができなかったので、生音をプリフェーダーでセンドしてバランスを取るか、あるいは生音を7割、センドを3割にしたりして。

- ステレオイン・アウトの設定はセパレート(sep.)ですか?

基本は[sep.](a|b)ですが、例えば1つのインプットを2つに分けたい時は[mix](a+b)にします。キーボードのモノラルの信号を左右に広げたい時とか。

- 録りで DMX を使うということですか?

そういうことです。今でこそ Roland JUNO とかはビンテージシンセだって言われていますけど、当時は「なんでこんな安っぽい音しかしないんだ?」って言われていたわけです。大体モノラルアウトだったりするし。だから、みんな DMX をかけてステレオに広げたりと、色々苦労していたわけです。今からすると、物自体は価値があるかもしれないけど、出ている音ってそんないい音じゃないですよ(笑)。

- DMX が1台しかないと作業が大変ですね。

だから、ミックスでどういうふうに DMX を使うかをプロデューサーと綿密に打ち合わせしました。途中で「やっぱりスネアの音を変えたい」となったら、ミックス用のルーティングを全部外して、ドラムのリプレイスをしてからまた元に戻すという、そういう作業をしていたわけです。だから、1曲のミックスが終わるのに1日以上かかるのは当然ですよね。面白かったですけど。

- 90年代以降、DMX の使い方は変化していきましたか?

そんなに変わっていないですね。僕の場合はテンポや曲調によって、ピッチとディレイの振れ幅を変えるくらい。「この曲はセブン・イレブンじゃなくて、9msと14msにしようかな」とか、それくらいです。Marcus Miller とか、機材を使いこなすプロデューサーの人達は、ボーカルを編集するために DMX をよく使っていましたね。彼は Luther Vandross とか著名な歌手もプロデュースしていたから、ボーカルエディターとして自分で DMX を所持していました。 自宅のスタジオに持ち帰ってピッチを直したり、そういう風に使っていたんじゃないですか。

- ステレオスプレッダーでもあり、ボーカル用ピッチエディターでもあるんですね。

当時はそういうピッチシフティングができるものがなかったし、DMX は抜群に音がいいですからね。アナログテープレコーダーのシンクヘッドからボーカルを再生して、DMX に取り込んでピッチが低いところを高くしておいて、そこだけパンチインして直したりとか。あと、スペシャルエフェクトとしてもよく使いますね。アルバムミックスみたいにキレイに整えるのではなくて、12インチとかダンスリミックスの時には、フィードバックをかけたモジュレーションが「ダダダダダダダダダ」って上がるようなディレイを入れて、スネアを飛ばしたりとか。

すごく品のいいエキスパンダーとして使うことが多い

- AMS DMX がUADプラグインとして使えるメリットは何でしょうか?

やっぱり抜群の安定感があることでしょう。そして何台も使える。でも、使い方は実機と同じです。最近だと JUJU のミックスでも使いました。MicroShift はプリセットがちょっとしかないので、DMX の方が幅があるんです。

- 下部に追加された、実機にはないコントローラーはどう使うものですか?

一番左にあるのはパンで、モノラルにすることもできます。その隣はディレイタイム。DMX の実機を使ったことがある人なら、テンキーでパラメーターを入力できると思うんですけど、初めて触る人はそれだと使い方がわからないから、ツマミでディレイタイムを設定できるようになっていますね。昔は、まずテンキーの[A]か[B]を押してチャンネルを選び、ディレイタイムを数値入力して、[#]を押して設定していましたから。その隣にあるフィルターは新機能ですね。フィルターをかけることによって、なだらかに落とせるんじゃないかな。で、その隣はピッチですね。ピッチもテンキーの[A]を押して[C]を押して[1*002]って押して[#]を押せばch.aを「1.002cent」に設定できるんだけど、それがツマミで設定できるようになりました。で、右端はコーラスですね。ピッチシフトにコーラスがかけられる。あと、他に新機能といえばsyncですよね。ディレイタイムを曲のテンポに合わせられます。

- テンポシンクは今や必須の機能ですよね。

そうなんですけど、僕は音符に合わせるような使い方をしないから、シンクさせずにフリーで使いますね。ディレイタイムを32分音符とかにすると、いくらステレオ効果が得られてもタイミングがずいぶん遅れてしまうので、大体7msくらい、長くても19msですね。24msくらいまで遅らせたこともありますね。Phil Collins のエンジニアとかは結構長めにしていたと思いますよ。僕はすごく品のいいエキスパンダーとして使うことが多いから、セブン・イレブンから始めて、曲のテンポとか雰囲気に合わせて調整します。

- サウンドの再現度はいかがですか?

やっぱり海外の人達は、これをすごく気にしているみたいですね。「実機と比べてどうなんだ?」って、よくメールで聞かれます。聴き比べてみると、実機の方がちょっと音像の幅が広いかな。ディスクリートでAD・DAしているので、ちょっと太く感じられますけど、効果はまったく同じです。ボーカルに同じような効果を加えるプラグインってたくさんありますけど、DMX があればほとんどカバーできちゃうし、それ以上のことができますね。

Goh Hotoda プロフィール

1960年生まれ。東京都出身。アメリカシカゴでキャリアをスタートし、1987にニューヨークに移り1990年マドンナの『VOGUE』のエンジニアリングを務め、今ではポピュラーとなったハウス・ミュージックの基盤を作った。 その後ジャネット・ジャクソン、ホイットニー・ヒューストン、坂本龍一、宇多田ヒカルなどの一流アーティストの作品を手がけ、トータル6000万枚以上の作品を世に送り出す。2度のグラミー賞受賞作品など世界的にも高い評価を受けている。仕事を通じ10年来の付き合いのあった『REBECCA』のNOKKOと2001年に結婚。現在はDolby Atomos 対応のミックスとハイレベルなマスタリングスタジオを可能とした3世代目となるstudio GO and NOKKOを所有。